- Política

- 27.05.2019

OPINIÓN

El gran Larreta te vigila

El reconocimiento facial ya llevó a una serie de detenciones arbitrarias por errores en el sistema. Mientras en ciudades de Estados Unidos lo retiran por eso mismo, acá lo incorporamos con alegría

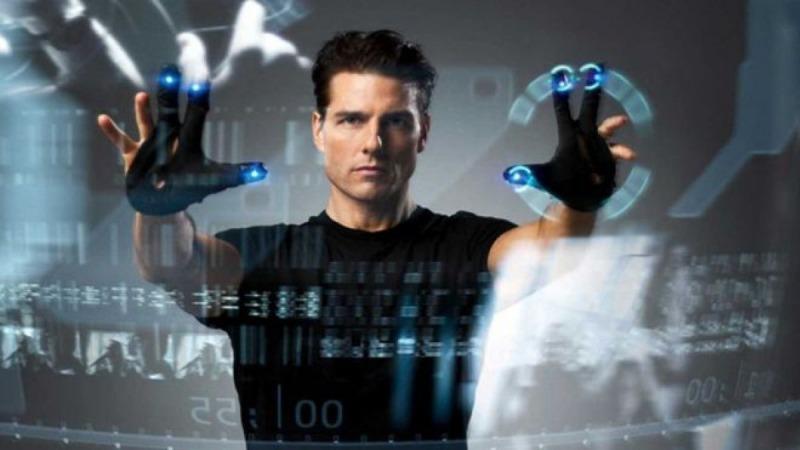

Quienes hayan visto la película de Steven Spielberg Minority report -sobre una policía que descubre a los criminales antes de que cometan sus delitos- recordarán que había cámaras por todos lados y que les leían los ojos para encontrarlos en cada punto de la ciudad. No solo para vigilarlos, sino también para hacerles propagandas comerciales personalizadas, de forma no muy distinta a como funcionan los algoritmos de Google o Facebook. No sé si esto también estaba en la novela de Philip K. Dick, pero claramente contribuía en la película a dar esa sensación de control total y estado policial. El gobierno de Horacio Rodríguez Larreta incorporó a puro festejo un sistema de reconocimiento facial para usar en las 300 cámaras de subtes y en las 7000 que llevan instaladas en toda la Ciudad. Sirve, según anunció, para detectar prófugos. No obstante, el sistema ya llevó a una serie de arrestos erróneos por parecidos a una persona buscada. En Estados Unidos ya hay ciudades que prohibieron ese sistema. Señalaron, además de la pérdida de libertades y del derecho a la privacidad que implica, que los errores son más frecuentes en mujeres y en personas de piel negra.

Resuelta la interna hace tiempo con Patricia Bullrich (con la victoria de ella sobre Larreta), el jefe de Gobierno abrazó el punitivismo en toda la línea. Hace unas semanas, presentó el sistema de reconocimiento facial aplicado a las cámaras de la Ciudad. “El objetivo es que los vecinos estén más seguros y no estén caminando alrededor de delincuentes”, sostuvo Larreta. El vicejefe de Gobierno y ministro de Seguridad, Diego Santilli, advirtió que se iba a cuidar la privacidad de las personas porque el programa solo iba a buscar en una base de datos de 40 mil personas buscadas, que figuran en el Sistema de Consulta Nacional de Rebeldías y Capturas (Conarc). El uso de esa tecnología tiene un costo de 2.300.000 pesos (por 17 meses de licencia). Según dijo Santilli, solo se guardan las imágenes que dan positivo, mientras que las otras se destruyen. No obstante, de entrada el sistema recibió críticas por sus potencialidades de control de la población a niveles abusivos.

Pasaron solo 20 días para que las advertencias de especialistas y organismos de derechos humanos comenzaran a hacerse realidad, con casos de detenciones arbitrarias producto de errores en el software que, según habían informado cuando se lanzó, tiene un 93,7 por ciento de efectividad. “Nadie va a quedar detenido porque se haya confundido en ese porcentaje de error ya que siempre se hace la confirmación correspondiente", dijeron en la presentación del software. Se lo van a tener que explicar a las mujeres que fueron capturadas y detenidas por horas a causa de un falso positivo.

El primer caso es el de una mujer que fue abordada por policías en el subte y, pese a explicarles que no era la persona que buscaban y mostrar su DNI, fue esposada y detenida en la noche del martes 14 de mayo. Le dijeron que estaba acusada en una causa por fraude habitacional, que existía desde 2011. Estuvo demorada varias horas en la primera comisaría a la que la llevaron. Se acercó una amiga de ella a preguntar por su situación y le dijeron que la iban a liberar, pero en lugar de eso la llevaron a una segunda comisaría, en la calle Suipacha. Allí estuvo incomunicada, dado que la policía solo permitía que entrara su abogado (que no tenía) y familiares (que no viven en Buenos Aires). Recién la liberaron el miércoles por la mañana, cuando comprobaron que, efectivamente, no era la persona a la que buscaban. Está evaluando si inicia acciones legales contra el Estado por esta detención arbitraria e injustificada.

El primer caso es el de una mujer que fue abordada por policías en el subte y, pese a explicarles que no era la persona que buscaban y mostrar su DNI, fue esposada y detenida en la noche del martes 14 de mayo. Le dijeron que estaba acusada en una causa por fraude habitacional, que existía desde 2011. Estuvo demorada varias horas en la primera comisaría a la que la llevaron. Se acercó una amiga de ella a preguntar por su situación y le dijeron que la iban a liberar, pero en lugar de eso la llevaron a una segunda comisaría, en la calle Suipacha. Allí estuvo incomunicada, dado que la policía solo permitía que entrara su abogado (que no tenía) y familiares (que no viven en Buenos Aires). Recién la liberaron el miércoles por la mañana, cuando comprobaron que, efectivamente, no era la persona a la que buscaban. Está evaluando si inicia acciones legales contra el Estado por esta detención arbitraria e injustificada.Segundo caso: una empleada doméstica fue detenida también en el subte, tras otro falso positivo del sistema de reconocimiento facial. En este caso, la policía la detuvo en la estación Constitución a las 10 de la mañana. La sacaron a la fuerza del vagón mientras la gente a su alrededor le gritaba “chorra”. También fue incomunicada, mientras su empleadora intentaba afuera explicarle a los policías que no era la persona que buscaban. La liberaron una hora más tarde. No había hecho nada.

Varios trabajadores del subte denunciaron otros falsos positivos sobre ellos mismos. Estas son las primeras consecuencias del sistema lanzado por Larreta que, según los funcionarios que lo presentaron, no iba a traer estas violaciones a los derechos de la población y había sido extensamente testeado. Lo cierto es que el riesgo está presente.

Es importante ver que está pasando con el reconocimiento facial en otras partes del mundo. San Francisco, por ejemplo, sacó una ordenanza para prohibirlos. Esa ciudad, cuna de Google y el desarrollo tecnológico y con un movimiento muy activo por los derechos civiles, consideró que la tecnología era abusiva y propensa a errores. Por eso votó el acta “Stop secret surveillance” (detengan la vigilancia secreta) en la Junta de Supervisores (la Legislatura de San Francisco). En otras ciudades como Oakland, Berkeley, y en Somerville, Massachusetts, van por el mismo camino. Igual, las agencias nacionales estadounidenses seguirán usando esa tecnología en los aeropuertos de esas ciudades. "Con esta votación, San Francisco ha declarado que la tecnología de vigilancia de cara es incompatible con una democracia saludable ", dijo Matt Cagle de la Union de Libertades Civiles de América. Entre los argumentos, señalaron que el software fue utilizado para identificar manifestantes en una protesta, apuntarle a la población negra y que tiende casualmente a dar falsos positivos sobre perfiles musulmanes, por lo que lo llaman “racismo automatizado”. Los grupos poblacionales más propensos a ser detenidos por falsos positivos son las mujeres y las personas de piel negra. De hecho, ese sistema reconoció en forma errónea a 28 miembros del Congreso de los Estados Unidos. ¿Qué tenían todos en común? Eran negros.

.gif)

COMENTARIOS